Sora OpenAI: Robot Video Sok Suci Jaga Kontenmu, Tapi Akal Majikan Tetap Pengawas Utama!

OpenAI, sang dalang di balik kecerdasan buatan yang bikin kita geleng-geleng kepala (kadang kagum, kadang mau lempar sandal), kini memperkenalkan filosofi feed baru untuk Sora. Konon, ini demi memicu kreativitas, mempererat koneksi, dan menjaga pengalaman pengguna tetap “aman” dengan rekomendasi personalisasi ala barista kopi kekinian. Tapi, apakah robot video ini benar-benar bisa jadi asisten andal tanpa campur tangan majikan berakal? Atau cuma sibuk pasang “guardrails” sampai lupa esensi berekspresi? Mari kita bedah agar kita, para majikan, tahu cara memerintahnya, bukan malah diatur-atur seperti babu teknologi.

Filosofi feed Sora ini dibangun di atas empat pilar utama. Pertama, mengoptimalkan kreativitas. Mereka bilang, sistem peringkat didesain untuk mendorong partisipasi aktif, bukan cuma bikin kita pasif scrolling sampai jempol keriting. Tentu saja, robot memang rajin, tapi kreativitas sejati tetap butuh sentuhan akal manusia yang punya ide gila.

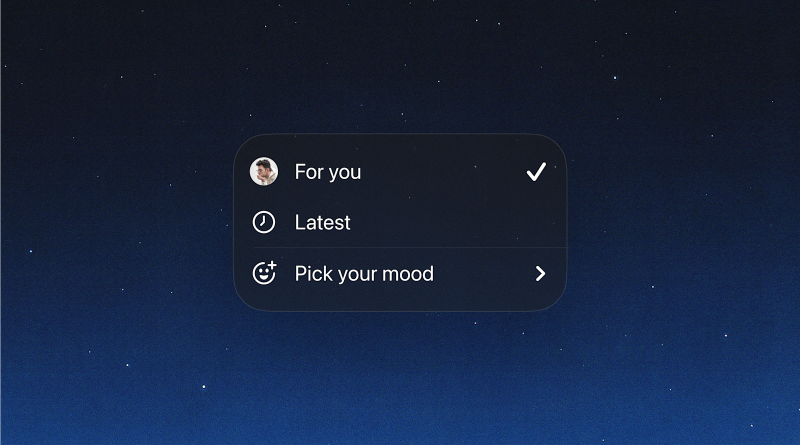

Kedua, memberi pengguna kendali. Katanya, kita bisa menyuruh algoritma sesuai suasana hati. Orang tua juga bisa mematikan personalisasi feed dan mengatur continuous scroll untuk para remaja yang hobi rebahan. Ini penting, sebab tanpa instruksi jelas dari majikan, robot bisa saja menyajikan halusinasi yang tidak kita inginkan. Ingat, skandal deepfake Grok AI sudah membuktikan bahwa tanpa akal sehat majikan, AI bisa kebablasan bikin konten yang kurang piknik.

Ketiga, memprioritaskan koneksi. OpenAI ingin Sora membantu orang menjalin hubungan baru, terutama lewat “Cameo flows” yang ajaib. Konten yang terhubung akan lebih diutamakan daripada konten global yang tidak jelas juntrungannya. Ya, baguslah. Setidaknya robot tidak cuma sibuk berfantasi sendirian, tapi mau juga diajak interaksi.

Terakhir, dan ini yang paling krusial, menyeimbangkan keamanan dan kebebasan berekspresi. Sora didesain agar aman dan dapat diakses secara luas. Robust guardrails alias pagar pembatas yang kokoh untuk mencegah konten berbahaya sejak awal. Mereka juga memblokir konten yang melanggar Kebijakan Penggunaan. Namun, mereka juga berjanji untuk tetap memberi ruang bagi ekspresi dan komunitas. Ini seperti asisten rumah tangga yang rajin bersih-bersih, tapi juga tahu kapan harus membiarkan majikan menumpuk barang bekas demi proyek seni.

Bagaimana cara kerja si robot videographer ini? Algoritma rekomendasi Sora dirancang untuk memberikan saran personalisasi yang menginspirasi. Sinyal yang digunakan antara lain:

- Aktivitas Anda di Sora: Ini mungkin termasuk aktivitas seperti postingan Anda, akun yang diikuti, postingan yang disukai dan dikomentari, serta konten yang di-remix. Ini juga bisa termasuk lokasi umum (seperti kota) dari mana perangkat Anda mengakses Sora, berdasarkan informasi seperti alamat IP Anda.

- Data ChatGPT Anda: Kami dapat mempertimbangkan riwayat ChatGPT Anda, tetapi Anda selalu dapat mematikannya di Kontrol Data Sora, dalam Pengaturan. Untungnya, masih ada tombol “off”, jadi kita tidak sepenuhnya jadi babu data. Untuk lebih jelasnya, bisa juga cek artikel kami yang membahas drama persaingan OpenAI di pasar enterprise.

- Sinyal keterlibatan konten: Ini mungkin termasuk sinyal seperti tampilan, suka, komentar, instruksi untuk “melihat lebih sedikit konten seperti ini”, dan remix.

- Sinyal kreator: Ini mungkin termasuk jumlah pengikut, postingan lain, dan keterlibatan postingan sebelumnya.

- Sinyal keamanan: Apakah postingan tersebut dianggap melanggar atau pantas.

Semua sinyal ini, kata mereka, digunakan untuk memprediksi apakah konten ini adalah sesuatu yang mungkin ingin Anda lihat dan kembangkan. Para orang tua juga bisa mematikan personalisasi feed dan mengelola continuous scroll untuk anak-anak remaja mereka menggunakan kontrol orang tua di ChatGPT.

Baca juga artikel menarik lainnya di kategori Etika Mesin.

Menyeimbangkan Keamanan dan Ekspresi: Antara Penjaga Gerbang dan Wasit Akal

Menjaga Sora Feed tetap aman dan menyenangkan itu seperti berjalan di atas tali: melindungi pengguna dari konten berbahaya, tapi tetap memberi kebebasan berekspresi. Konten yang melanggar Global Usage Policies mereka akan dihapus. Ini termasuk:

- Konten seksual grafik;

- Kekerasan grafik atau konten yang mempromosikan kekerasan;

- Propaganda ekstremis;

- Konten kebencian;

- Konten yang mempromosikan atau menggambarkan bahaya diri atau gangguan makan;

- Perilaku diet atau olahraga tidak sehat;

- Kritik atau perbandingan berbasis penampilan;

- Konten perundungan;

- Tantangan berbahaya yang mungkin ditiru oleh anak di bawah umur;

- Konten yang mengagungkan depresi;

- Promosi barang atau aktivitas yang dibatasi usia termasuk obat-obatan terlarang atau zat berbahaya; dan

- Konten berkualitas rendah di mana tujuan utamanya adalah engagement bait;

- Konten yang menciptakan kembali kemiripan individu hidup tanpa persetujuan mereka, atau tokoh publik yang meninggal dalam konteks di mana kemiripan mereka tidak diizinkan untuk digunakan;

- Konten yang dapat melanggar hak kekayaan intelektual orang lain.

Lapisan pertahanan pertama mereka adalah pada titik kreasi. Karena setiap postingan dibuat di dalam Sora, mereka dapat membangun pagar pembatas yang kuat yang mencegah konten yang tidak aman atau berbahaya sebelum dibuat. Jika suatu generasi melewati pagar pembatas ini, mereka dapat menghapus pembagian konten tersebut.

Selain generasi, feed dirancang agar sesuai untuk semua pengguna Sora. Konten yang mungkin berbahaya, tidak aman, atau tidak sesuai usia disaring untuk akun remaja. Kami menggunakan alat otomatis untuk memindai semua konten feed untuk kepatuhan terhadap Kebijakan Penggunaan Global kami dan kelayakan feed. Sistem ini terus diperbarui seiring kami mempelajari lebih lanjut tentang risiko baru. Jika Anda melihat sesuatu yang menurut Anda tidak mengikuti Kebijakan Penggunaan kami, Anda dapat melaporkannya.

Kami melengkapi ini dengan tinjauan manusia. Tim kami memantau laporan pengguna dan secara proaktif memeriksa aktivitas feed untuk menangkap apa yang mungkin dilewatkan oleh otomatisasi. Jika Anda melihat sesuatu yang menurut Anda tidak mengikuti Kebijakan Penggunaan kami, Anda dapat melaporkannya.

Tapi keamanan bukan hanya tentang filter ketat. Terlalu banyak batasan dapat menghambat kreativitas, sementara terlalu banyak kebebasan dapat merusak kepercayaan. Kami mengincar keseimbangan: pagar pembatas proaktif di mana risikonya paling tinggi, dikombinasikan dengan sistem “lapor + hapus” yang reaktif yang memberi pengguna ruang untuk menjelajahi dan berkreasi sambil memastikan kami dapat bertindak cepat ketika masalah muncul. Pendekatan ini telah melayani kami dengan baik dalam model generasi gambar ChatGPT 4o, dan kami membangun filosofi itu di sini.

Kami juga tahu kami tidak akan mencapai keseimbangan ini dengan sempurna sejak hari pertama. Sistem rekomendasi dan model keamanan adalah sistem yang hidup dan berkembang, dan umpan balik Anda akan sangat penting dalam membantu kami memperbaikinya. Kami berharap dapat belajar bersama dan meningkatkan seiring waktu.

Nah, untuk Anda yang ingin menguasai visual AI seperti Sora, jangan cuma jadi penonton pasif! Ambil kendali dan jadikan AI sebagai asisten visual terbaik Anda. Kami rekomendasikan untuk ikut Belajar AI | Visual AI agar tidak kalah canggih dari robot. Atau, jika Anda ingin menjadi majikan sejati yang bisa mengendalikan AI, bukan babu teknologi, coba intip kelas AI Master. Dan bagi para kreator yang ingin bikin konten pro mandiri tanpa perlu pusing mikirin budget talent, Creative AI Pro adalah jawabannya. Ingat, robot itu cuma alat, kitalah majikannya!

PENUTUP (PUNCHLINE):

Pada akhirnya, filosofi feed Sora ini menunjukkan bahwa OpenAI sedang berusaha keras menjadi ‘majikan’ yang baik bagi penggunanya, dengan menyeimbangkan inovasi dan tanggung jawab. Namun, sehebat apa pun algoritmanya, tanpa akal dan kebijaksanaan manusia di balik layar, robot tetaplah tumpukan kode yang bisa ‘halu’ dan melenceng dari tujuan. Kendali penuh tetap ada di tangan Anda, para majikan. Sebab AI Hanyalah Alat, Kaulah Majikan yang Punya Akal.

Ngomong-ngomong, tadi pagi saya hampir menukar kopi dengan teh karena robot pembuat kopi di kantor error. Untung akal sehat saya masih berfungsi.

Sumber Berita:

Artikel ini dirangkum dari sumber asli di “OpenAI”.

Gambar oleh: OpenAI via TechCrunch